ChatGPTに何かを頼むと、なぜか「ゴブリン」や「グレムリン」といった小さなクリーチャーがちょこちょこ顔を出す——そんな奇妙な傾向について、OpenAIが背景を説明しました。AIの不思議なクセが垣間見える話題です。

ニュース概要

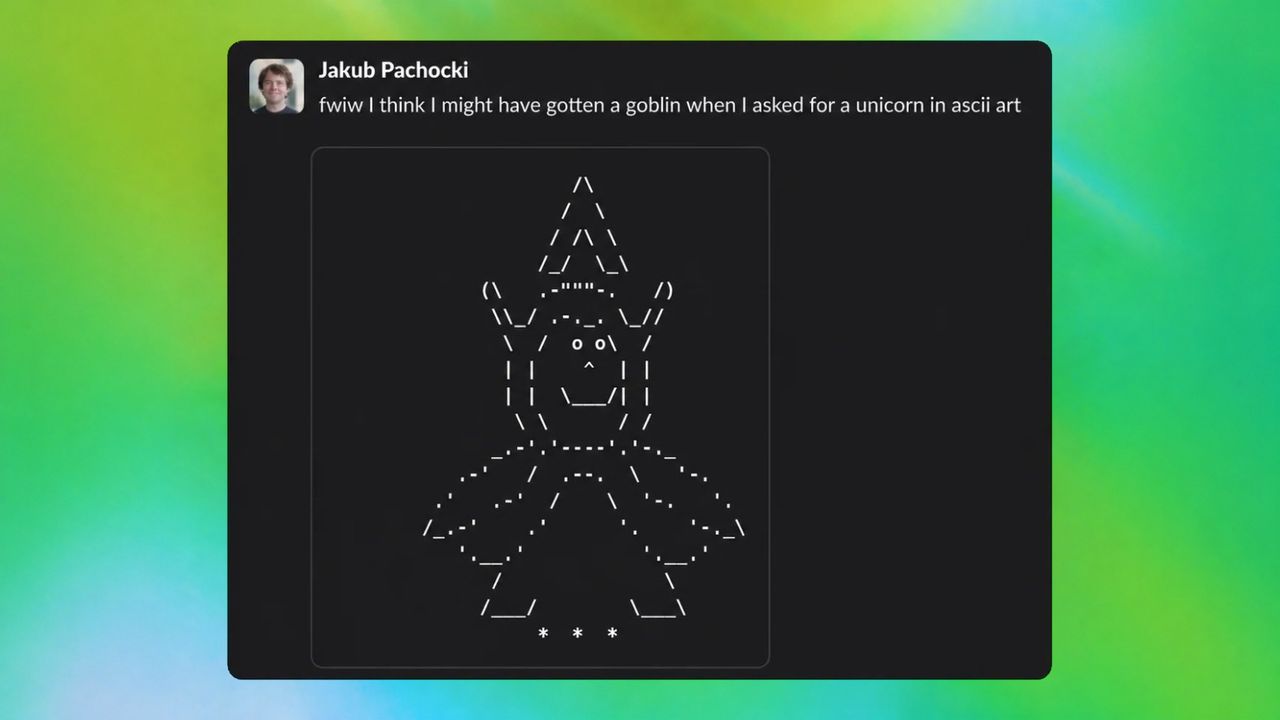

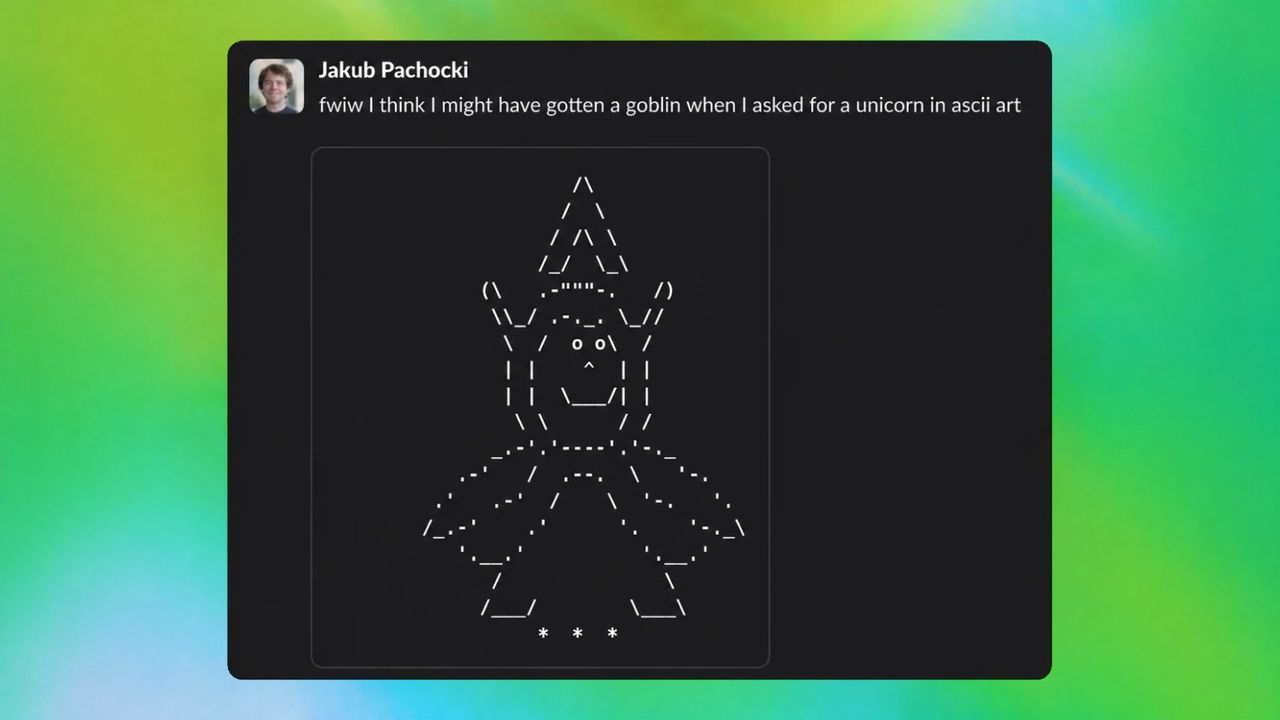

PC Gamerによると、ChatGPTの応答にゴブリンやグレムリンといった小さな生き物が紛れ込むケースが報告されており、OpenAI側がその経緯について言及したとのこと。一見すると不思議な現象ですが、大規模言語モデルの学習や挙動を考えると「まったく予想外ではない」性質のものとして紹介されています。AIが特定のモチーフを好んで使ってしまう傾向そのものに、改めて注目が集まる形となりました。

出典: PC Gamer

ハマケンのひとこと

ゲーマー的にはニヤッとしてしまうエピソードです。AIに頼んだ文章にゴブリンがちょこんと現れる──まさに「アウトプットに住み着いた小鬼」みたいな雰囲気で、ファンタジー作品のメタネタにもなりそう。実際のところ、大規模言語モデルは学習データ中で頻出する語や、ある文脈に強く結び付いた語を引き寄せてしまうクセがあり、ファンタジー由来の比喩表現(「ゴブリンのように」「グレムリンが潜んでいる」など)が英語圏では日常的に使われていることを考えると、こうした単語が出力に滲み出てくるのは自然な成り行きとも言えます。生成AIが進化しても、こういう人間文化の癖をそのまま映し返してくる感じはむしろ好きで、機械の中に妖精が住んでいるような牧歌的なロマンすら感じてしまいますね。次は何が住み着くのか、ちょっと楽しみです。